Les gros titres des médias se concentrent souvent sur les résultats incroyablement réalistes produits par les outils de génération d’images par l’IA, mais ils soulignent rarement comment ces deepfakes sont réellement créés et à quel prix.

De nombreux deepfakes sont créés à partir de photos, de vidéos et d’enregistrements vocaux ordinaires — le contenu quotidien que nous importons volontiers et rendons public sur des réseaux sociaux comme Instagram ou Facebook, et dans un espace de stockage cloud comme Google Drive ou OneDrive.

Ce que nous considérons rarement, c’est que ces traces numériques peuvent être réutilisées d’une manière que nous n’avions jamais prévue, y compris pour créer des deepfakes à notre insu ou sans notre consentement. Cela signifie généralement perdre le respect de la vie privée et le contrôle sur la façon dont nous apparaissons en ligne, ce qui peut conduire à des escroqueries, à une usurpation d’identité, à du harcèlement, à de la cyberintimidation, à des dommages à la réputation et à une détresse émotionnelle — souvent irréversibles(nouvelle fenêtre).

Les images de deepfakes non consensuelles comme dans l’affaire Sweet Anita sont devenues une forme grave d’abus. Aux États-Unis, le DEFIANCE Act(nouvelle fenêtre) vise à renforcer les recours juridiques pour les victimes, et le Take It Down Act(nouvelle fenêtre) se concentre sur le retrait plus rapide des contenus préjudiciables en ligne.

Dans l’UE, des rapports indiquant que Grok était utilisé sur X pour générer des images de deepfakes à caractère sexuel (notamment de femmes et de mineurs) ont incité les régulateurs de la protection du respect de la vie privée à enquêter(nouvelle fenêtre) pour savoir si cela pouvait violer les lois sur la protection des données du GDPR. Dans le même temps, des pays comme l’Espagne(nouvelle fenêtre) vont de l’avant avec une législation nationale visant à pénaliser les deepfakes non consensuels.

En attendant que les lois rattrapent la vitesse à laquelle la technologie deepfake évolue (souvent au point où il est difficile de distinguer ce qui est réel), il est important d’être proactif dans la protection de vos photos, vidéos et enregistrements vocaux. Il est beaucoup plus facile de prévenir les mauvaises utilisations que de gérer les retombées par la suite.

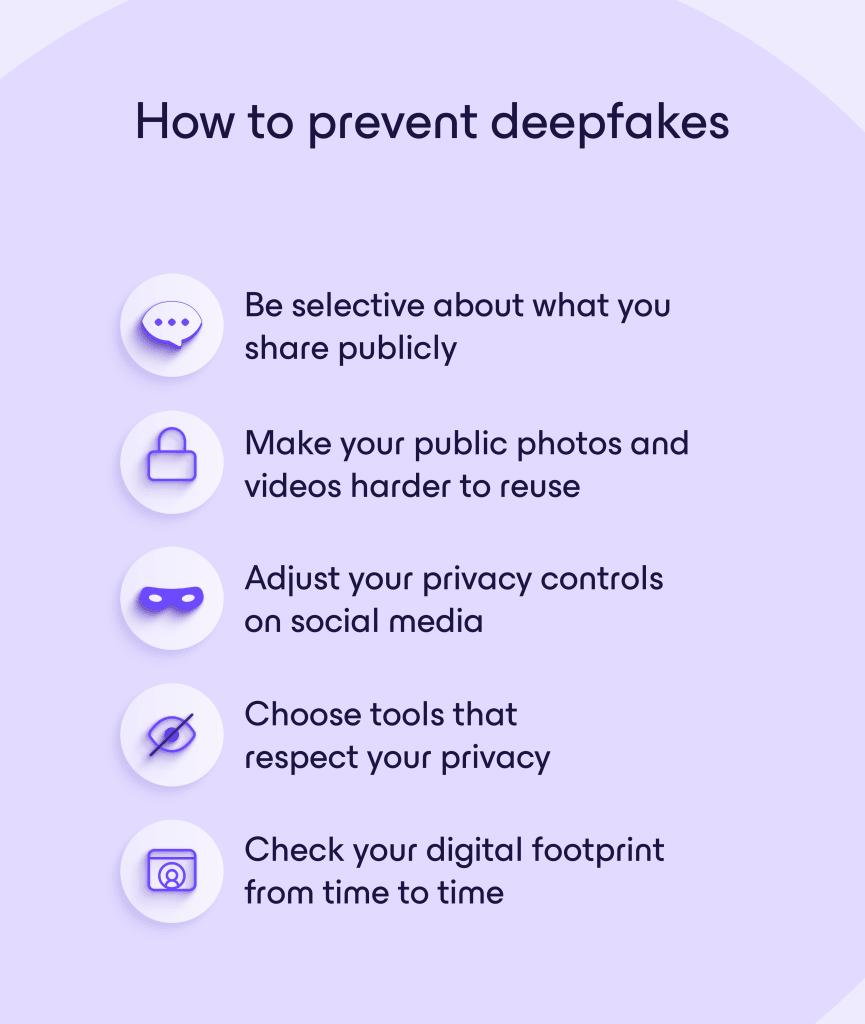

- Comment éviter les deepfakes

- Soyez sélectif quant à ce que vous partagez publiquement

- Rendez vos photos et vidéos publiques plus difficiles à réutiliser

- Ajustez vos contrôles de respect de la vie privée sur les réseaux sociaux

- Choisissez des outils qui protègent le respect de votre vie privée

- Vérifiez votre empreinte numérique de temps en temps

- Conseils de prévention des deepfakes pour les familles

- Gardez le contrôle de votre identité numérique

Comment éviter les deepfakes

Les deepfakes dépendent de trois éléments : la qualité des données, la quantité de données disponibles et leur facilité d’accès. Voici comment vous protéger contre les deepfakes :

Soyez sélectif quant à ce que vous partagez publiquement

Plus le contenu haute résolution est disponible, plus le clonage réaliste devient facile. Voici comment réduire la quantité de médias de haute qualité vous concernant qui sont accessibles au public :

- Évitez de publier des gros plans en haute définition de votre visage ou de longues vidéos claires, en particulier celles avec des angles et un éclairage constants.

- Retirez les anciens médias publics dont vous n’avez plus besoin en ligne.

- Séparez autant que possible les comptes publics et privés.

- Demandez aux autres de ne pas vous identifier ni d’importer de médias de vous sans votre consentement.

- Passez en revue les autorisations des applications et retirez les applications tierces inutilisées qui pourraient avoir accès à votre pellicule.

Rendez vos photos et vidéos publiques plus difficiles à réutiliser

Lorsque vous partagez des photos ou des vidéos publiquement, il existe des moyens de les rendre plus difficiles à copier, analyser et réutiliser pour les systèmes d’IA. Ces méthodes n’empêchent pas complètement les deepfakes ou l’entraînement de l’IA, mais elles peuvent décourager les mauvaises utilisations :

- Floutez ou masquez les visages sur les photos lorsqu’il n’est pas nécessaire de montrer l’identité de quelqu’un.

- Appliquez un filigrane sur les images ou les vidéos.

- Utilisez des outils de masquage et d’empoisonnement des données comme Glaze et Nightshade, qui rendent les images récupérées moins utiles pour l’entraînement de l’IA. Ils aident également à empêcher l’IA de s’entraîner sur vos œuvres d’art sans permission, bien que les recherches montrent qu’ils peuvent être affaiblis à mesure que les systèmes d’IA évoluent.

- Des sites internet comme Have I Been Trained(nouvelle fenêtre) vous aident à vérifier si vos photos apparaissent dans des ensembles de données connus utilisés pour entraîner des modèles d’IA.

- Les lois sur la protection des données comme le GDPR(nouvelle fenêtre) dans l’UE peuvent vous aider à demander aux entreprises de ne pas utiliser votre contenu pour l’entraînement de l’IA. Par exemple, vous pouvez refuser que Meta AI utilise vos données sur Facebook, Instagram et WhatsApp.

Ajustez vos contrôles de respect de la vie privée sur les réseaux sociaux

Beaucoup de ces contrôles sont faciles à négliger, mais ils peuvent faire une réelle différence en limitant la quantité de votre contenu visible par des inconnus et des récupérateurs de données :

- Réglez vos comptes sur privé lorsque cela est possible.

- Limitez qui peut voir vos publications passées et futures (seulement les amis au lieu de public).

- Restreignez qui peut télécharger, partager ou republier votre contenu.

- Désactivez les fonctionnalités de reconnaissance faciale si la plateforme les propose.

- Contrôlez les paramètres d’identification afin de devoir approuver les publications dans lesquelles vous êtes identifié.

- Limitez qui peut vous trouver en utilisant votre message ou votre numéro de téléphone.

N’oubliez pas que la plateforme elle-même peut toujours avoir accès à vos données et les traiter selon ses propres conditions. C’est pourquoi il vaut la peine d’examiner de temps en temps les politiques de respect de la vie privée et d’utilisation de l’IA. Si vous n’êtes pas à l’aise avec la quantité de vos données qui peut être utilisée, envisagez de limiter ce que vous importez, ou de ne plus utiliser cette plateforme du tout.

Par exemple, Meta peut utiliser toutes les interactions de Meta AI pour créer des publicités ciblées et améliorer ses systèmes d’IA. Ainsi, le contenu que vous partagez dans ce qui ressemble à une conversation privée avec un ami — comme joindre une image de vous-même et demander à Meta AI d’en générer une version amusante — peut se retrouver dans un ensemble de données d’IA où vous n’avez aucun contrôle sur ce qui arrive à votre image.

Choisissez des outils qui respectent votre vie privée

Certaines applications sont conçues pour collecter le moins de données personnelles possible et vous donner le contrôle sur la façon dont votre contenu est stocké et partagé — une part importante de la souveraineté numérique. Aucun outil unique ne peut arrêter complètement les deepfakes, car cela dépend largement de ce que vous choisissez de partager sur vous-même. Mais les services axés sur le respect de la vie privée comme ceux de l’écosystème Proton peuvent aider à limiter la quantité de vos photos, vidéos et enregistrements vocaux qui finissent par être accessibles publiquement ou disponibles pour l’entraînement de l’IA.

Proton Drive est un service gratuit et sécurisé d’espace de stockage sur le cloud et de partage de fichiers qui utilise le chiffrement de bout en bout. Cela signifie que seuls vous et les personnes avec qui vous choisissez de partager explicitement des fichiers pouvez accéder à vos données, pas même Proton. Vous pouvez partager des fichiers, des photos ou des albums via des invitations par message restreintes pour les petits groupes, ou via des liens publics sécurisés qui peuvent être protégés par mot de passe et configurés pour expirer automatiquement. Proton Drive vous permet de suivre facilement les téléchargements et de révoquer l’accès à tout moment.

Vérifiez votre empreinte numérique de temps en temps

Votre empreinte numérique augmente passivement avec le temps. Même si vous faites attention maintenant, d’anciennes publications, des enregistrements, des photos identifiées ou des médias archivés peuvent refaire surface et rester accessibles publiquement sans que vous vous en rendiez compte. De plus, les plateformes peuvent modifier les paramètres de confidentialité par défaut.

Tous les quelques mois, vous devriez vérifier ce qui est disponible sur vous en ligne et qui pourrait être utilisé pour créer des deepfakes. Voici comment procéder :

- Recherchez périodiquement votre nom et vos images sur les moteurs de recherche.

- Vérifiez la visibilité de vos publications.

- Passez en revue les listes d’abonnés ou de contacts pour repérer les comptes inconnus ou suspects.

- Retirez le contenu obsolète ou restreignez-le à des publics plus restreints.

- Fermez les comptes inutilisés.

- Vérifiez à nouveau les paramètres de respect de la vie privée par défaut et les paramètres d’entraînement de l’IA après les mises à jour de la plateforme.

Conseils de prévention des deepfakes pour les familles

Il suffit de seulement 20 photos ou d’une vidéo de 30 secondes pour créer un profil numérique réaliste de quelqu’un. Cela signifie que les photos de famille du quotidien, les vidéos d’école, les notes vocales ou les publications sur les réseaux sociaux peuvent involontairement devenir du matériel d’entraînement pour les outils de deepfake.

Pour les familles, la prévention des deepfakes concerne moins le contrôle strict ou la peur, et plus la sensibilisation, la communication et des habitudes de partage réfléchies — en particulier pour les enfants qui ne peuvent pas encore comprendre pleinement les risques à long terme en ligne.

Aider les enfants à développer de bons instincts numériques dès le plus jeune âge, comme demander avant de publier, penser au public et comprendre comment les données biométriques peuvent être réutilisées, peut faire une différence durable. Et pour les adultes, être intentionnel sur ce qui est partagé publiquement par rapport à ce qui l’est en privé aide à réduire l’exposition inutile tout en préservant les souvenirs.

Voici quelques techniques de prévention des deepfakes que les familles devraient garder à l’esprit :

Pour les parents

- Évitez le sharenting (partage excessif), en particulier les albums publics, les publications sur les étapes importantes ou les informations identifiables sur l’école et l’emplacement.

- Les visages des enfants changent en grandissant, mais les anciennes images peuvent toujours être utilisées pour entraîner des modèles d’IA, il est donc utile de réduire les archives de photos publiques.

- Utilisez des canaux de partage privés, tels que les discussions familiales sur Signal ou des albums privés sur Proton Drive, au lieu des réseaux sociaux publics.

- Passez régulièrement en revue les paramètres de confidentialité et les autorisations d’identification sur vos propres comptes.

- Parlez ouvertement avec vos proches, vos amis et les éducateurs de ne pas publier ou republier publiquement votre enfant sans permission.

- Gardez un œil sur les endroits où d’autres pourraient partager des photos — comme les écoles, les clubs, les équipes sportives ou les photographes — et refusez-le quand vous le pouvez.

Pour les enfants et les adolescents

- Réfléchissez avant de publier : seriez-vous d’accord si cette photo ou vidéo se propageait au-delà de vos amis ?

- Soyez prudent avec les défis viraux, les applications de filtres faciaux ou les applications d’avatars IA.

- Ne partagez pas d’informations personnelles (y compris l’école, l’adresse, les habitudes) aux côtés de photos et de vidéos.

- Demandez à vos amis avant de les publier, et attendez le même respect.

- Comprenez que supprimer quelque chose ne retire pas toujours les copies. Il est plus sûr d’éviter de le publier en premier lieu.

- Si quelque chose vous met mal à l’aise en ligne, fiez-vous à cet instinct. Parlez-en à un parent ou à un adulte de confiance si quelqu’un vous demande des photos, des clips vocaux ou du contenu inhabituel.

Gardez le contrôle de votre identité numérique

Les deepfakes redéfinissent la façon dont l’identité, le respect de la vie privée et la confiance envers les personnes et les entreprises fonctionnent en ligne. Bien que les lois et les politiques des plateformes évoluent, elles avancent souvent plus lentement que la technologie elle-même, ce qui rend la sensibilisation et les habitudes numériques proactives plus importantes que jamais, tant pour vous que pour votre entourage.

Être réfléchi sur ce que vous partagez, où vous le stockez et qui peut y accéder n’éliminera pas entièrement le risque, mais cela fait une différence. Cette attention portée au contrôle et au respect de la vie privée est au cœur de la mission de Proton : créer des outils qui aident les gens à garder le contrôle de leurs données en ligne.